44,8 Prozent und damit fast die Hälfte der Deutschen fürchten, gefälschte Videos nicht (mehr) erkennen zu können. 58,8 Prozent der Umfrage-Teilnehmer*innen haben Angst davor, dass Deepfakes für kriminelle Zwecke missbraucht werden. Und sogar knapp drei Viertel (71,5 Prozent) der Befragten sehen in Deepfakes eine Gefahr für die Glaubwürdigkeit der Medien. Denn was bei den lustigen Apps bloß ein großer Spaß ist, kann bei bewussten Täuschungen und manipulierten Nachrichten schnell zum Problem werden: Etwa wenn Identitäten gestohlen oder Politiker*innen Worte in den Mund gelegt werden, die sie nie gesagt haben.

Ein kurzes Tippen auf das Smartphone – und schon lächelt das eigene Gesicht von Supermans Körper oder aus dem neuen Beyoncé-Musikvideo. Möglich machen dies sogenannte Deepfake-Apps, die mithilfe künstlicher Intelligenz (KI) authentisch wirkende Video-Illusionen erzeugen und vor allem in sozialen Netzwerken beliebt sind. Eine neue repräsentative Umfrage von nextMedia.Hamburg zeigt jedoch: Vielen Menschen in Deutschland bereiten die automatisierten Manipulations-Möglichkeiten von Video, Bild oder Ton Sorgen. Gleichzeitig sind die positiven Erwartungen an KI als Zukunftstechnologie hoch.

Mehr als 70 % der Befragten sehen Deepfakes als Gefahr für glaubwürdige Medien

Mehr Aufklärung erforderlich, Kennzeichnung gefordert

Das Problem: Deepfake-Algorithmen können Gesichtszüge und Stimmen heutzutage nahezu perfekt imitieren. „Bis vor einigen Jahren galten Videos und Tonaufnahmen in der Regel als Belege für Realität“, so Dr. Nina Klaß, Leiterin von Next Media Hamburg. Das hat sich jedoch geändert. „Viele der Deepfakes, die uns heute in den sozialen Medien begegnen, werden kreativ und für Unterhaltungszwecke entwickelt, aber natürlich gibt es da auch negative Ausnahmen, die vor allem der Täuschung der Öffentlichkeit und der bewussten Verzerrung von Fakten dienen“, unterstreicht Klaß. Deswegen gelte es, Aufklärung darüber zu betreiben, was technisch bereits alles möglich sei und im zweiten Schritt eine Kennzeichnungspflicht von Deepfake-Inhalten einzuführen. Von denjenigen, die die Technologie verstanden haben, sprach sich eine klare Mehrheit (58,1 Prozent) für eine Deepfake-Kennzeichnungspflicht aus.

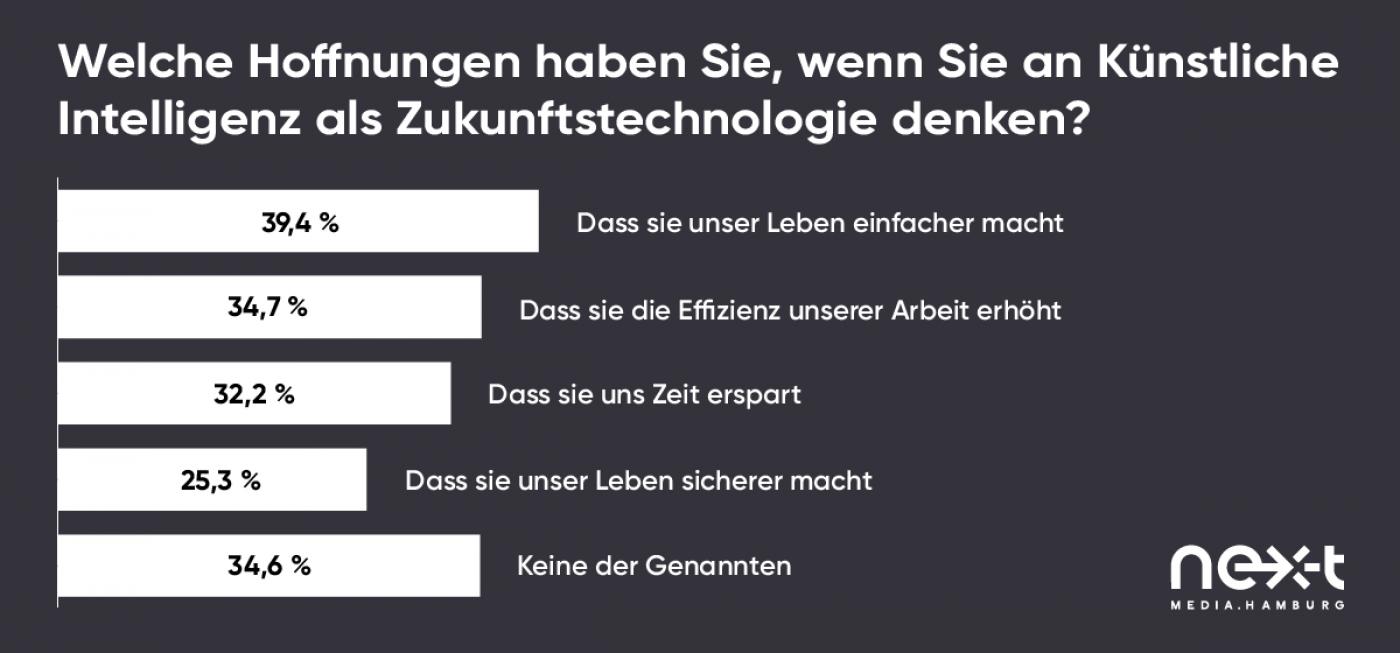

Künstliche Intelligenz: eine Zukunftstechnologie – viele Hoffnungen

Unabhängig vom Thema Deepfakes knüpfen die Menschen in Deutschland überwiegend Hoffnungen an künstliche Intelligenz als Zukunftstechnologie. Viele glauben, dass KI ihr Leben einfacher (39,4 Prozent) und sicherer (25,3 Prozent) macht. Und jeweils rund jede*r Dritte hofft, dass sich dank KI die Effizienz der eigenen Arbeit erhöht (34,7 Prozent) und Zeit gespart wird (32,2 Prozent). Dahingegen versprechen sich 34,6 Prozent der Befragten sich durch KI nichts von alledem.

Im Auftrag von nextMedia.Hamburg hat das Markt- und Meinungsforschungsunternehmen Civey zwischen dem 28. Juni und dem 11. Juli 2021 über 2.500 Menschen in Deutschland befragt. Die Ergebnisse sind repräsentativ für die deutsche Gesamtbevölkerung.

cb/sb

Quellen und weitere Informationen

Ähnliche Artikel

Künstliche Intelligenz: Frauen erobern die Schlüsseltechnologie

Uni Hamburg-Studie: Auch virtuelle Natur ist gut für Stimmung und Job